![AI 도구 선택 보안 체크리스트: 업무용 AI 안전하게 쓰는 기준 12가지 [2026]](https://bsp-media-prod.sungwoo-sw.workers.dev/media/ai-edu-22-1-01.png)

AI 도구 선택 보안 체크리스트: 업무용 AI 안전하게 쓰는 기준 12가지 [2026]

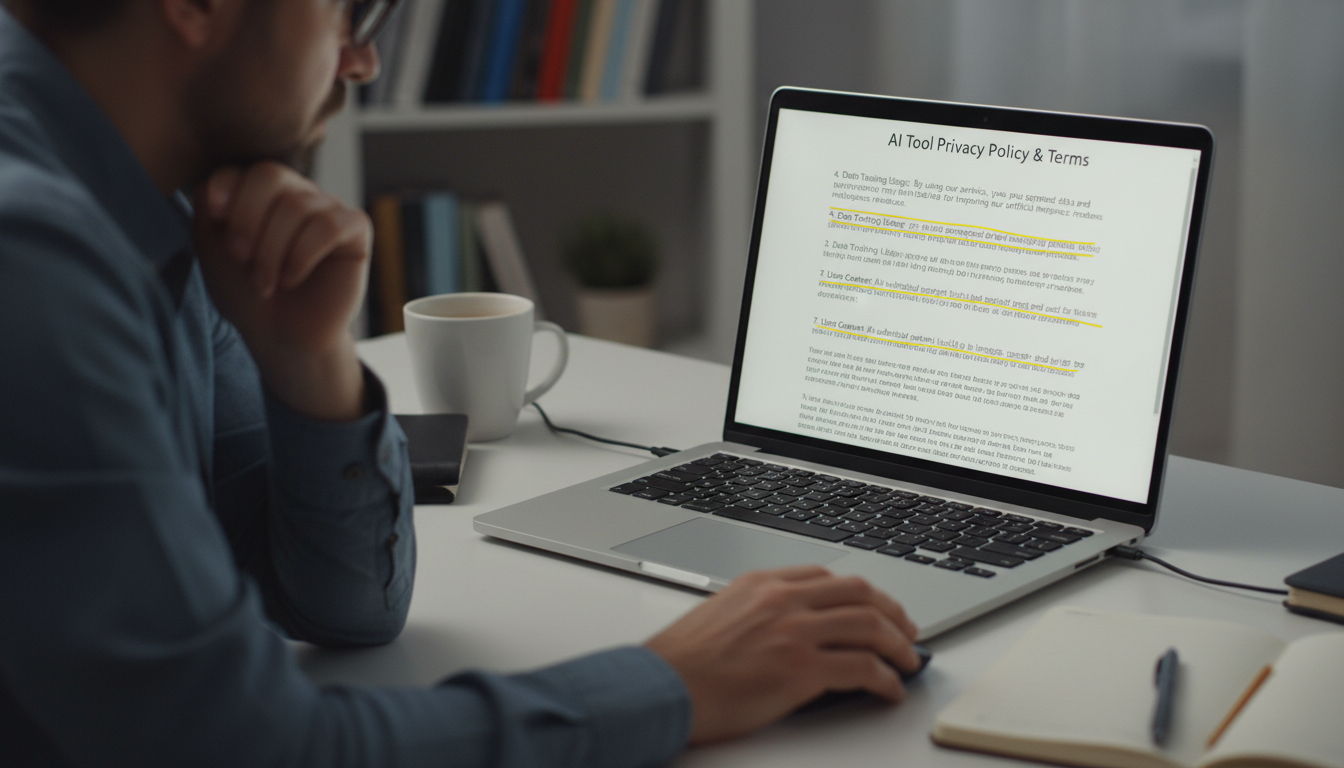

업무에 AI 도구를 도입할 때 기능과 가격만 확인하는 경우가 많습니다. 하지만 회사 내부 정보, 고객 데이터, 미공개 정보가 담긴 문서를 AI에 입력하기 전에 보안 측면에서 먼저 확인해야 할 항목들이 있습니다. 잘못된 AI 도구 선택은 데이터 유출, 규정 위반, 법적 문제로 이어질 수 있습니다.

- 업무용 AI 도구 선택 전 가장 먼저 확인할 것은 "입력 데이터를 AI 학습에 사용하는가"입니다. 개인용 플랜(ChatGPT Plus, Claude Pro)은 설정에 따라 학습에 사용될 수 있으며, 기업 기밀 업무에는 반드시 Enterprise 플랜이나 데이터 학습 면제가 보장된 플랜을 사용해야 합니다.

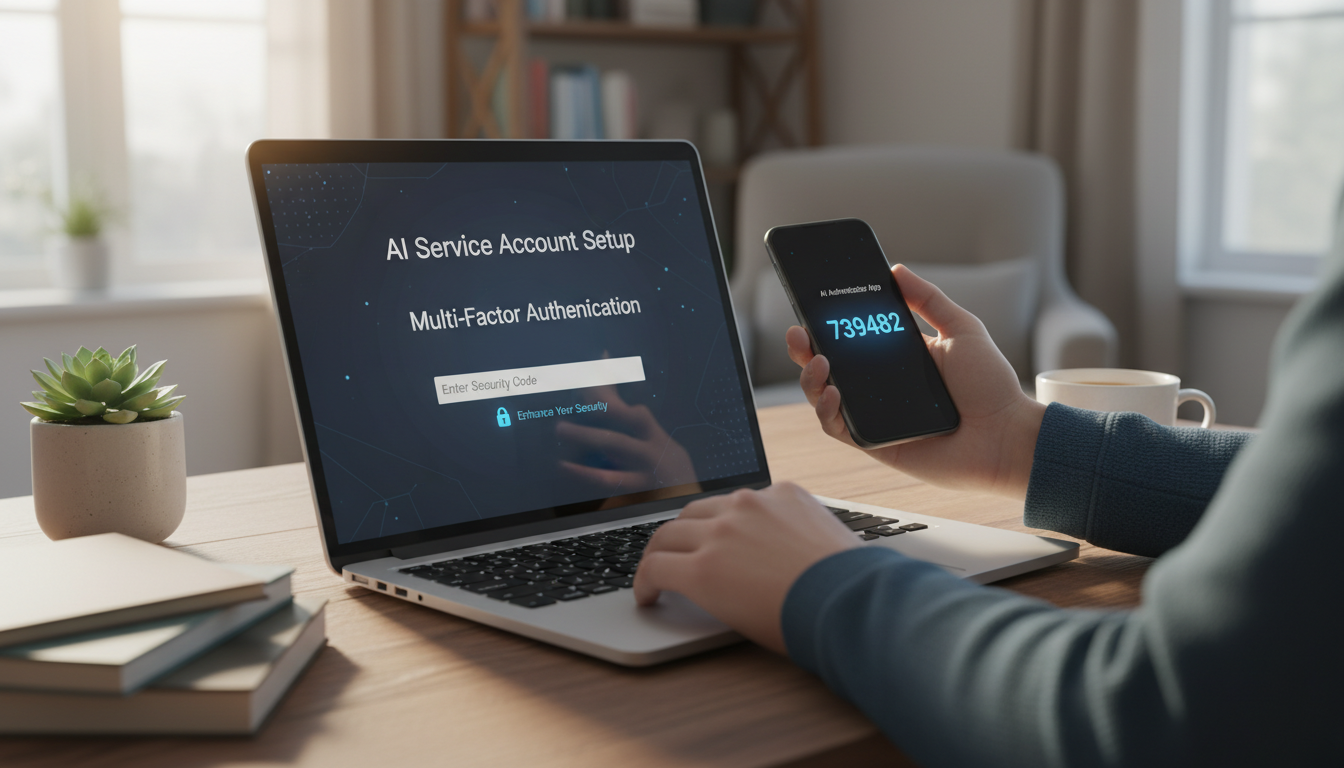

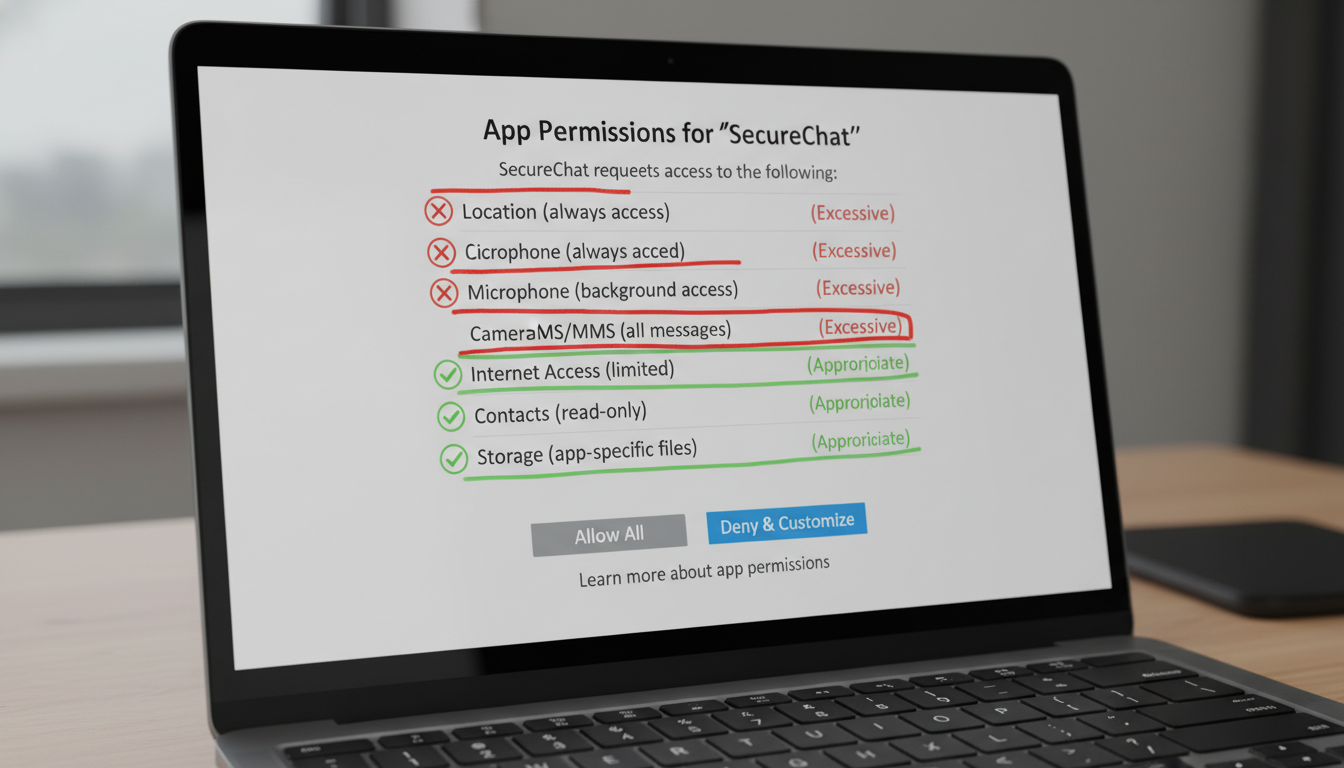

- AI 보안 체크리스트 12가지는 데이터 정책(3), 계정 보안(3), 연동 앱 권한(3), 규정 준수(3) 4개 영역으로 구성됩니다. MFA 활성화와 연동 앱 권한 최소화가 계정 침해를 막는 가장 실천적인 항목입니다.

- AI에 절대 입력하면 안 되는 정보: 고객 개인식별정보, 미공개 재무 정보, 회사 비밀번호·API 키, 특허 출원 전 기술 정보. 입력이 필요한 경우 비식별화(고객명 → "A 고객", 금액 → "X원") 후 입력합니다.

AI 보안 문제가 발생하는 주요 경로

AI 보안 문제가 발생하는 주요 경로

입력 데이터의 AI 학습 사용

일부 AI 서비스는 사용자가 입력한 내용을 모델 개선에 활용합니다. 고객 정보, 내부 기밀이 입력되면 제3자에게 노출될 위험이 있습니다.

연동 앱의 과도한 권한

AI 도구를 이메일, 캘린더, 파일 서버와 연동할 때 불필요하게 넓은 접근 권한을 요청하는 경우가 있습니다. 의도치 않은 데이터 접근이 발생합니다.

계정 침해

공용 비밀번호를 쓰거나 MFA가 없는 경우, 계정이 침해되면 해당 AI 도구에 저장된 대화 내용과 문서가 모두 노출됩니다.

AI 도구 선택 전 보안 체크리스트

AI 도구 선택 전 보안 체크리스트

AI 도구별 보안 수준 비교

AI 도구별 보안 수준 비교

| AI 도구 | 플랜 | 데이터 학습 | 보안 인증 | 추천 환경 |

|---|---|---|---|---|

| ChatGPT Plus | 개인 | 설정 비활성화 가능 | 없음 | 비기밀 개인 업무 |

| ChatGPT Enterprise | 기업 | 학습 안 함 | SOC 2 Type II | 기업 기밀 업무 |

| Claude Pro | 개인 | 학습 사용 가능 | 없음 | 비기밀 개인 업무 |

| Claude Team/Enterprise | 기업 | 학습 안 함 | SOC 2 Type II, HIPAA | 기업 기밀 업무 |

| Microsoft Copilot 365 | 기업 | 학습 안 함 | Azure 보안 체계 | 기업 MS 환경 |

| Gemini Workspace | 기업 | 관리 설정 시 학습 안 함 | Google 보안 체계 | Google 워크스페이스 기업 |

개인용 플랜(Plus, Pro)은 기본 설정에서 입력 데이터가 학습에 사용될 수 있습니다. 기업 기밀, 고객 개인정보, 내부 재무 정보를 다루는 경우에는 반드시 기업용 플랜(Enterprise)을 사용하거나, 해당 정보를 AI에 입력하지 않아야 합니다.

Claude Team은 Claude Pro의 기능에 데이터 학습 면제, SOC 2 Type II 보안 인증, 팀 관리 기능이 추가된 기업용 플랜입니다. Enterprise 플랜보다 낮은 비용으로 기업 보안 기준을 충족할 수 있습니다.

Claude Team 자세히 보기 →* 기업용 구독 서비스 · 제휴 링크

AI 도구 안전하게 쓰는 실천 지침

AI 도구 안전하게 쓰는 실천 지침

입력하면 안 되는 정보 유형

-

고객 성명·연락처·주민번호 등 개인식별정보

-

미공개 실적·계약 금액·인수합병 관련 정보

-

회사 비밀번호·API 키·내부 시스템 접속 정보

-

특허 출원 전인 기술 정보·영업 비밀

입력 전 비식별화 방법

| 원본 정보 | 비식별화 후 |

|---|---|

| 홍길동 대리 (010-xxxx-xxxx) | A 직원 |

| 계약금액 3억 2천만원 | 계약금액 X억 Y천만원 |

| 삼성전자 2026 Q1 실적 데이터 | A기업 2026 Q1 실적 데이터 |

| 주민번호 900101-1234567 | 입력 금지 (완전 제외) |

팀 공유 AI 도구 사용 시 주의사항

공용 계정 사용 금지

팀에서 하나의 계정을 공유하면 누가 어떤 정보를 입력했는지 기록이 남지 않습니다. 개인별 계정 사용이 원칙입니다.

관리자 모니터링 확인

팀용 플랜은 관리자 계정으로 사용 내역을 모니터링할 수 있는지 확인합니다. 민감한 프로젝트에는 별도 대화 스레드를 사용합니다.

정기적 권한 검토

연동된 앱과 부여된 권한을 3개월에 한 번씩 검토합니다. 더 이상 사용하지 않는 앱의 연동은 즉시 해제합니다.

내부 정책 공유

AI 도구 사용 범위와 금지 정보 유형을 팀 내 문서로 공유합니다. 구두 안내보다 문서화된 가이드가 더 효과적입니다.

마무리: AI 보안은 도구 선택부터 시작된다

마무리: AI 보안은 도구 선택부터 시작된다

AI 도구 선택 보안 체크리스트 핵심을 정리합니다.

-

개인용 플랜: 비기밀 업무에 한정, 민감 정보 입력 금지

-

기업 기밀 업무: Enterprise 플랜 또는 데이터 학습 면제 확인

-

MFA 반드시 활성화, 팀 공용 계정 사용 금지

-

연동 앱 권한 최소화, 불필요한 앱 연동 차단

-

입력 전 비식별화 습관화 (고객명 → "A 고객", 금액 → "X원")

AI 도구 도입의 효율성과 보안성은 함께 고려해야 합니다. 보안 체크리스트를 한 번 확인하는 것만으로도 데이터 유출 위험을 크게 줄일 수 있습니다.

Comments

Comments (0)

Leave a Comment