![회사 데이터 AI 연동 안전성: 기업 AI 도구 보안 기준 완벽 가이드 [2026]](https://bsp-media-prod.sungwoo-sw.workers.dev/media/ai-edu-22-2-01.png)

회사 데이터 AI 연동 안전성: 기업 AI 도구 보안 기준 완벽 가이드 [2026]

이 글의 핵심 요약

이 글의 핵심 요약

- 회사 데이터 AI 연동 안전성은 어떤 데이터를, 어떤 방식으로, 어떤 서비스에 연동하느냐에 따라 결정된다. 한국 기업의 74%가 AI를 가장 큰 데이터 보안 위험으로 인식하지만, 데이터를 연동 가능/조건부/금지 3단계로 분류하면 안전한 범위와 위험한 범위를 명확히 구분할 수 있다.

- 연동 방식에 따라 보안 수준이 다르다. 웹 UI(낮음) < API(중간) < Enterprise(높음) < 온프레미스(최고) 순서다. 클라우드 민감 데이터의 47%가 암호화되지 않은 상태이므로, 연동 방식 선택이 곧 보안 수준을 결정한다.

- 연동 전 5단계 체크리스트(약관 확인 → 학습 설정 OFF → 데이터 분류 → 비식별 처리 → 로그 관리)를 10분이면 수행할 수 있다. 고객 개인정보를 무단 입력하면 개인정보보호법 위반으로 법적 책임이 발생한다.

회사 데이터 AI 연동 안전성, 업무 효율을 높이기 위해 회사 데이터를 AI 도구에 연동하고 싶지만 "이거 연동해도 괜찮은 건가?"라는 불안이 먼저 듭니다. CRM에 쌓인 고객 데이터를 AI로 분석하고 싶고, 엑셀로 관리하던 매출 데이터를 AI 대시보드에 연결하고 싶지만, 유출 사고가 나면 책임은 본인에게 돌아옵니다.

한국 기업의 74%가 AI를 가장 큰 데이터 보안 위험으로 인식하고 있다는 2026년 조사 결과가 있습니다(탈레스 데이터 위협 보고서). 그런데도 AI 도구 도입은 가속하고 있습니다. 이 글에서는 회사 데이터를 AI 도구에 연동할 때 안전한 범위와 위험한 범위를 구체적으로 구분하고, 직장인이 실무에서 적용할 수 있는 보안 기준을 제시합니다.

회사 데이터를 AI에 연동할 때 실제로 일어나는 일

회사 데이터를 AI에 연동할 때 실제로 일어나는 일

회사 데이터를 AI 도구에 연동한다는 것은, 데이터가 사내 서버에서 외부 클라우드로 이동한다는 의미입니다. 이 과정에서 데이터는 전송, 저장, 처리라는 세 단계를 거치며, 각 단계마다 서로 다른 보안 위험이 존재합니다.

전송 단계에서는 데이터가 인터넷을 통해 이동하면서 중간에 가로채질 수 있습니다. TLS/SSL 암호화가 적용된 서비스는 전송 중 데이터를 보호하지만, 암호화가 없는 서비스나 공용 와이파이 환경에서는 위험이 커집니다.

저장 단계에서는 데이터가 AI 회사의 서버에 남습니다. 서버가 해킹되면 저장된 데이터가 통째로 유출됩니다. 2026년 기준 한국 기업의 클라우드에 저장된 민감 데이터 중 47%가 암호화되지 않은 상태입니다. 저장 시 암호화(at-rest encryption) 여부가 안전성의 핵심입니다.

처리 단계에서는 AI 모델이 데이터를 학습하거나 분석합니다. 학습에 사용된 데이터는 모델에 녹아들어 삭제가 불가능합니다. API 방식의 연동은 대부분 학습에 사용하지 않지만, 웹 인터페이스를 통한 입력은 서비스마다 정책이 다릅니다.

AI 도구 연동 유형별 보안 수준 비교

AI 도구 연동 유형별 보안 수준 비교

모든 AI 연동이 동일한 위험을 지니는 것은 아닙니다. 연동 방식에 따라 보안 수준이 크게 달라지며, 직장인이 선택할 수 있는 범위도 다릅니다.

| 연동 방식 | 데이터 이동 위치 | 학습 사용 | 관리자 통제 | 보안 수준 | 적합한 데이터 |

|---|---|---|---|---|---|

| 웹 UI 직접 입력 | AI 회사 클라우드 | 서비스별 상이 | 없음 | 낮음 | 공개 정보만 |

| API 연동 | AI 회사 클라우드 | 대부분 미사용 | 키 관리 가능 | 중간 | 비식별 업무 데이터 |

| Enterprise 플랜 | AI 회사 전용 인스턴스 | 완전 제외 | 전체 가능 | 높음 | 내부 업무 데이터 |

| 온프레미스 LLM | 사내 서버 | 해당 없음 | 전체 가능 | 최고 | 기밀 포함 모든 데이터 |

| 하이브리드 (RAG) | 사내 DB + 클라우드 AI | 미사용 (쿼리만 전송) | 부분 가능 | 높음 | 구조화된 내부 데이터 |

핵심적인 차이는 '데이터가 어디에 머무는가'입니다. 웹 UI 직접 입력은 데이터 통제권이 완전히 AI 회사로 넘어갑니다. 반면 온프레미스 LLM은 데이터가 사내 서버를 벗어나지 않아 보안 수준이 가장 높습니다.

RAG(Retrieval-Augmented Generation) 방식은 사내 데이터베이스에서 관련 정보를 검색한 뒤, 검색 결과만 AI에 전송하여 응답을 생성하므로 전체 데이터가 클라우드로 이동하지 않습니다.

ChatGPT Enterprise는 데이터 학습 완전 제외, 전용 인스턴스, 관리자 전체 통제를 제공하여 내부 업무 데이터 연동에 적합합니다. 삼성SDS가 기업 고객에 Enterprise를 공급하면서 데이터 학습 제외와 전용 인스턴스를 핵심으로 내세운 것도 이런 맥락입니다.

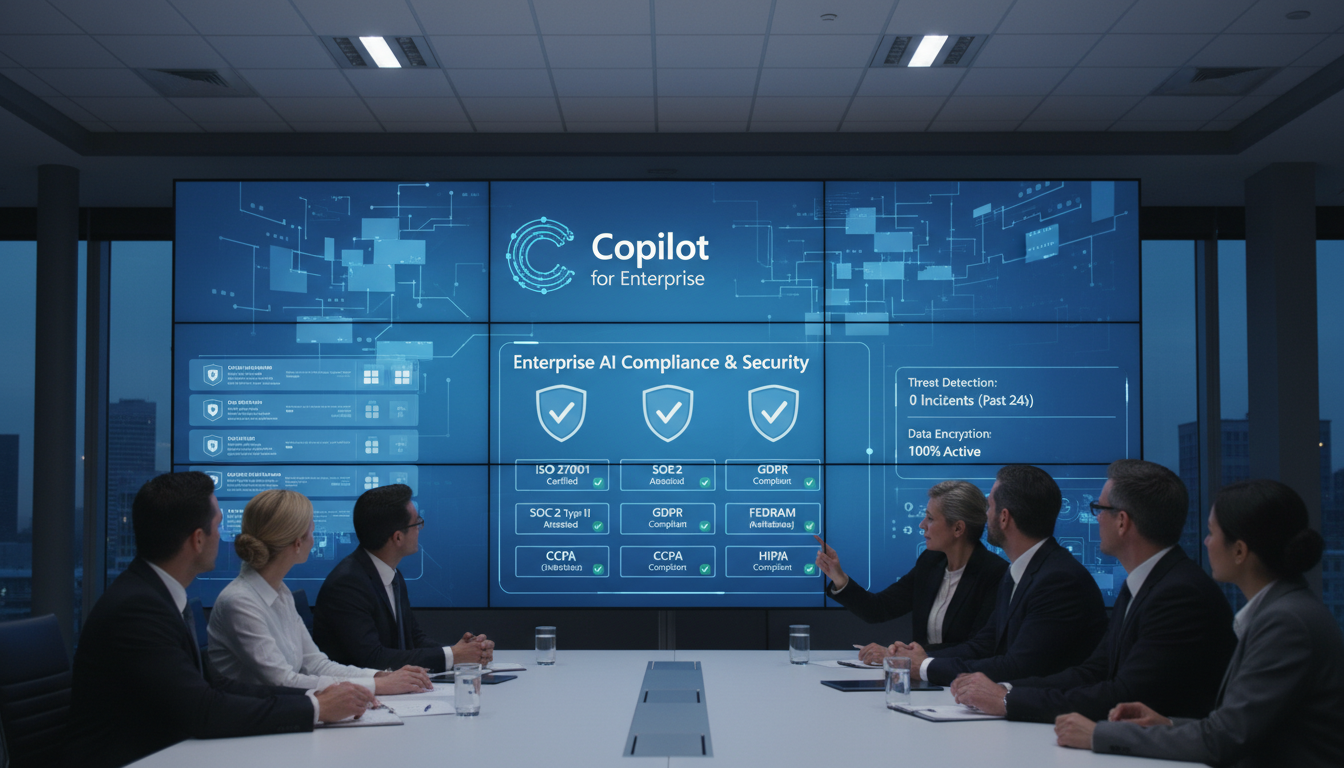

Microsoft Copilot for 365는 E3/E5 플랜에서 사내 데이터가 Microsoft의 격리된 테넌트에서만 처리되어 외부 학습에 사용되지 않으므로, 기존 Microsoft 365 환경을 사용하는 기업에 자연스러운 선택입니다.

어디까지 연동해도 안전한가 — 데이터 분류 기준

어디까지 연동해도 안전한가 — 데이터 분류 기준

많은 직장인이 "AI에 어떤 데이터를 넣어도 되는지"를 명확히 모른 채 감으로 판단하고 있습니다. "이 정도는 괜찮겠지"라는 판단이 보안 사고의 시작점입니다.

- 공개된 시장 데이터, 산업 리포트

- 일반적인 업무 프로세스 문서

- 익명화·비식별 처리된 통계 데이터

- 일반적인 문서 양식, 템플릿

- 공개 제품 정보, 공식 발표 자료

- 내부 업무 보고서 (기밀 아닌 것)

- 비식별 처리된 고객 행동 데이터

- 일반적인 영업 활동 기록

- 내부 교육 자료

- 비식별 처리된 설문 조사 결과

- 고객 개인정보 (이름, 연락처, 주민번호)

- 미공개 재무 데이터 (매출, 원가, 투자 계획)

- 핵심 기술 자산 (소스코드, 특허 전 기술)

- 인사 기밀 (급여, 평가, 징계 기록)

- NDA 적용 거래처 정보, 계약 조건

- Enterprise 플랜 또는 API 연동 + 데이터 학습 미사용 확인 시에만 허용

- 온프레미스 LLM을 사용하더라도 접근 권한 관리가 선행되어야 함

- 개인정보를 무단 입력하면 개인정보보호법 위반으로 최대 5천만 원 과태료 대상

비식별 처리를 적용하면 조건부 데이터도 안전하게 활용할 수 있습니다.

삼성전자와의 계약 금액은 2억 5천만 원이며, 담당자 김철수(010-1234-5678)가 내일 서명 예정입니다.

[거래처명]와의 계약 금액은 [XX억 원]이며, 담당자 [담당자명]([연락처 삭제])가 내일 서명 예정입니다.

실무에서 바로 적용하는 보안 체크리스트 5단계

실무에서 바로 적용하는 보안 체크리스트 5단계

AI 도구에 회사 데이터를 연동하기 전, 아래 5단계를 수행하면 대부분의 보안 위험을 사전에 차단할 수 있습니다. 대기업은 IT 보안팀이 담당하지만, 중소기업이나 스타트업에서는 직원 개개인의 판단에 맡기는 경우가 많습니다.

서비스 약관(ToS)과 개인정보처리방침에서 "입력 데이터의 모델 학습 사용 여부"와 "데이터 보관 기간"을 확인합니다.

ChatGPT: Settings > Data Controls, Gemini: Activity 설정, Claude: Privacy 설정에서 각각 확인하고 OFF로 변경합니다.

연동할 데이터를 "연동 가능/조건부/금지" 3단계로 분류합니다. 분류 없이 "이 정도는 괜찮겠지"라는 판단이 사고를 만듭니다.

조건부 연동 데이터는 고객명을 "고객A", 금액을 "XX만 원", 프로젝트명을 "프로젝트X"로 치환합니다.

Enterprise 플랜은 관리자 대시보드에서 추적 가능합니다. 개인 수준에서는 어떤 데이터를 어떤 AI에 입력했는지 기록을 남기는 습관이 필요합니다.

아래 체크리스트로 현재 나의 AI 연동 보안 상태를 점검해 보세요.

- 데이터가 어디에 저장되고, 학습에 사용되는지가 안전성의 핵심이다

- 데이터를 3단계(연동 가능/조건부/금지)로 분류한 뒤 연동 여부를 결정한다

- 웹 UI < API < Enterprise < 온프레미스 순서로 보안 수준이 높아진다

- 비식별 처리를 거치면 조건부 데이터도 안전하게 활용할 수 있다

- 회사 보안 정책이 없더라도 5단계 체크리스트로 개인 수준의 보안을 확보한다

Comments

Comments (0)

Leave a Comment